PNO - Không chỉ người nổi tiếng, cả phụ nữ bình thường cũng bị những kẻ lừa đảo cắt ghép video để quảng cáo phản cảm.

| Chia sẻ bài viết: |

“Người đàn bà khóc” - Nhân vật rùng rợn sinh ra từ thảm kịch

Nhân vật Điêu Thuyền có tồn tại hay không?

Kỳ bí con tàu ma "lang thang" giữa biển lạnh

"Người đàn ông đội mũ” xuất hiện trong những giấc mơ liên quan gì tới "bóng đè"?

"Lời nguyền" về đoạn kết bi thảm cho người sở hữu viên kim cương đẹp nhất thế giới

Europol vừa thông báo đã phối hợp với lực lượng chức năng nhiều quốc gia châu Âu triệt phá thành công 4 đường dây buôn lậu ma túy lớn.

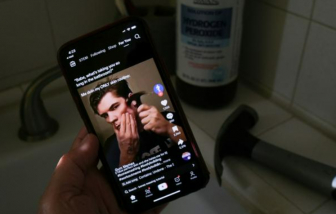

Xu hướng looksmaxxing đang trở thành một ngành công nghiệp những người có sức ảnh hưởng thúc đẩy những gì các chuyên gia gọi là tiêu chuẩn vẻ đẹp độc hại.

Nghiên cứu trên 420.000 người dân Anh cho thấy việc đi bộ với tốc độ ít nhất 4mph (tương đương 6,4km/h) có thể giảm nguy cơ mắc các bệnh về tim.

Cách mọi người tương tác với mạng xã hội có thể có tác động lớn đến chất lượng giấc ngủ và ảnh hưởng xấu tớisức khỏe tinh thần.

Ngày 15/4, Liên hiệp quốc cho biết nhiều cuộc khủng hoảng đang diễn ra đã làm trầm trọng thêm các nhu cầu nhân đạo hiện có.

Ngày 14/4, các quan chức y tế cho biết bão cát ở miền trung và miền nam Iraq đã khiến hơn 1.800 người phải nhập viện do các bệnh về hô hấp.

Ngày 15/4, cảnh sát Nhật Bản cho biết đã bắt giữ 4 người vì tội bán hình ảnh khiêu dâm được tạo ra bằng AI trong đợt truy quét đầu tiên.

Những bệnh nhân mắc loại ung thư da nguy hiểm nhất sẽ được tiếp cận nhanh chóng với vắc-xin phòng ung thư được gọi là "mang tính cách mạng" của Anh.

Biển nóng hơn khiến các cơn bão xuất hiện dày đặc và phá hủy các hệ sinh thái quan trọng như rừng tảo bẹ và rạn san hô.

Thông qua những khoảng nghỉ ngắn hạn giữa sự nghiệp, nhiều lao động trẻ muốn phục hồi năng lượng, sức khỏe cho mình trước khi trở lại guồng quay công việc.

Các nhà nghiên cứu ở Anh nuôi cấy răng từ tế bào người, là bước đột phá có thể giúp bệnh nhân “mọc” lại răng đã mất trong tương lai.

Các nhà nghiên cứu từ MattressNextDay phát hiện rằng, 1 chú gấu bông trung bình chứa lượng vi khuẩn gấp đôi 1 cái... bệ bồn cầu.

2 phụ nữ Trung Quốc đã bị chỉ trích vì nằm giữa đường cao tốc ở Nhật Bản để chụp ảnh trong khi tai nạn làm giao thông tê liệt.

Lựa chọn lối sống ít năng lượng khiến những người trẻ tuổi thích nằm dài trên giường, sống bằng thức ăn mang về, tránh giao lưu, thích sống ẩn dật...

Một nghiên cứu mới cho thấy việc thêm muối vào thức ăn có thể làm tăng nguy cơ mắc bệnh trầm cảm và lo âu.

Sáng ngày 14/4, cựu Tổng thống Hàn Quốc Yoon Suk Yeol đã tự bào chữa trong phiên tòa hình sự đầu tiên về cáo buộc nổi loạn.

Hơn 3 triệu trẻ em tử vong vào năm 2022 liên quan đến nhiễm trùng kháng thuốc, do sử dụng quá mức hoặc sử dụng sai một số loại thuốc.

Mối lo ngại về an toàn công cộng gia tăng ở Hàn Quốc khi nhiều nơi bị sụp đổ trên khắp thành phố Seoul.