PNO - Sự bùng nổ kỹ thuật số của Hàn Quốc đã tăng thêm sự tiện lợi nhưng cũng mở ra lĩnh vực tội phạm nghiêm trọng mới: tội phạm tình dục trực tuyến.

“Người đàn bà khóc” - Nhân vật rùng rợn sinh ra từ thảm kịch

Nhân vật Điêu Thuyền có tồn tại hay không?

Kỳ bí con tàu ma "lang thang" giữa biển lạnh

"Người đàn ông đội mũ” xuất hiện trong những giấc mơ liên quan gì tới "bóng đè"?

"Lời nguyền" về đoạn kết bi thảm cho người sở hữu viên kim cương đẹp nhất thế giới

Bạn đã từng được "ai đó vô hình" cứu mạng?

Các nhà nghiên cứu từ MattressNextDay phát hiện rằng, 1 chú gấu bông trung bình chứa lượng vi khuẩn gấp đôi 1 cái... bệ bồn cầu.

2 phụ nữ Trung Quốc đã bị chỉ trích vì nằm giữa đường cao tốc ở Nhật Bản để chụp ảnh trong khi tai nạn làm giao thông tê liệt.

Lựa chọn lối sống ít năng lượng khiến những người trẻ tuổi thích nằm dài trên giường, sống bằng thức ăn mang về, tránh giao lưu, thích sống ẩn dật...

Một nghiên cứu mới cho thấy việc thêm muối vào thức ăn có thể làm tăng nguy cơ mắc bệnh trầm cảm và lo âu.

Sáng ngày 14/4, cựu Tổng thống Hàn Quốc Yoon Suk Yeol đã tự bào chữa trong phiên tòa hình sự đầu tiên về cáo buộc nổi loạn.

Hơn 3 triệu trẻ em tử vong vào năm 2022 liên quan đến nhiễm trùng kháng thuốc, do sử dụng quá mức hoặc sử dụng sai một số loại thuốc.

Mối lo ngại về an toàn công cộng gia tăng ở Hàn Quốc khi nhiều nơi bị sụp đổ trên khắp thành phố Seoul.

Sáng 14/4, chuyến bay có người lái lần thứ 11 trên tàu vũ trụ New Shepard (NS-31) với phi hành đoàn toàn nữ đầu tiên kể từ năm 1963 sẽ khởi hành.

Nhiệt độ ấm, gió mạnh, điều kiện khô hạn có thể tạo ra môi trường nguy hiểm cho các đám cháy mới phát triển ở các vùng phía Tây và phía Nam

Một trận động đất mạnh 5,6 độ richter đã xảy ra tại Myanmar vào sáng 13/4, trong lúc người dân chào đón năm mới cổ truyền giữa khung cảnh đổ nát.

Một người mẹ đơn thân làm công việc quét đường ở khu phố Tàu, Bangkok, đã trở thành người mẫu mới được các chuyên gia trang điểm chiêu mộ.

Ngày 12/4, các thành viên của WHO đã đạt được thỏa thuận về cách giải quyết các đại dịch trong tương lai sau 3 năm thảo luận.

Để “thù hận” nhấn chìm lý trí, một phụ nữ đã sản sinh nên một truyền thuyết ma quái, bi thảm và gây ám ảnh đến tận ngày nay.

Cảnh sát cho biết ít nhất 5 người đã thiệt mạng và 6 người khác bị thương trong vụ nổ xảy ra tại nhà máy ở bang Maharashtra, tây bắc Ấn Độ.

Vụ kiện do chi hội Hiệp hội Giáo sư Đại học Mỹ tại Harvard đệ trình cáo buộc chính quyền lợi dụng mục VI của Đạo luật Dân quyền.

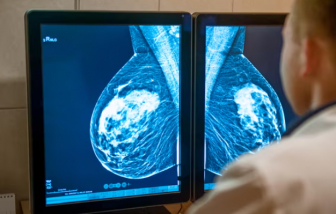

Ngày 11/4, Viện Y tế và Chăm sóc Sức khỏe Quốc gia Anh (NICE) đã chính thức cấp phép sử dụng capivasertib – loại thuốc điều trị ung thư vú mới.

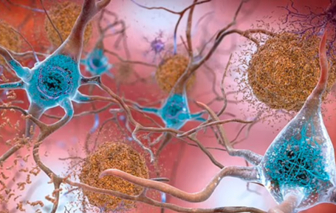

Nghiên cứu từ Canada cho thấy, cha mẹ bị Alzheimer thì con có nguy cơ bị protein độc hại lan truyền trong não, gây ra các bệnh về trí nhớ.

Ít nhất 100 người đã thiệt mạng trong 24 giờ qua tại 3 tiểu bang phía bắc Ấn Độ do giông bão và sét đánh dữ dội.