PNO - Giới chuyên gia lo ngại việc để các mô hình AI tương tác với giọng nói mô phỏng có thể dẫn đến những vụ lừa đảo khó nhận biết.

| Chia sẻ bài viết: |

Cơ quan di cư của Liên hợp quốc cho biết gần 9.000 người đã xác nhận thiệt mạng trên toàn thế giới vào năm 2024 khi cố gắng vượt biên.

Một nghiên cứu của OpenAI tìm thấy mối liên hệ giữa việc sử dụng ChatGPT và sự cô đơn.

Một nghiên cứu mới cho thấy tỉ lệ eo - hông ở tuổi trung niên có thể ảnh hưởng đến sức khỏe của não.

Trong 30 năm kể từ khi các nhà lãnh đạo lần đầu họp bàn về cách hạn chế biến đổi khí hậu, trái đất đã mất hơn 14.000 tỉ tấn băng.

Với áp lực kinh tế gia tăng và người trẻ càng ngày ưu tiên giá trị cá nhân, tỉ lệ kết hôn của Hàn Quốc đã giảm đều đặn.

Tăng thuế, gắn nhãn cảnh báo, cấm quảng cáo đồ uống có đường vượt ngưỡng là cách nhiều quốc gia ở châu Á áp dụng nhằm hạn chế tình trạng béo phì.

Ngày 21/3, các nhà chức trách cho biết, vụ sập mỏ ở miền nam Peru đã khiến ít nhất 4 người thiệt mạng và 4 người khác bị thương.

Các chuyên gia từ Mỹ cảnh báo, bệnh truyền nhiễm ở hươu và nai sừng tấm đang lan rộng khắp Hoa Kỳ, có thể bùng phát thành “cuộc khủng hoảng toàn cầu”.

Báo cáo của Ủy ban Di sản thế giới (UNESCO) nêu bật tình trạng sông băng biến mất với tốc độ “chưa từng có” do khủng hoảng khí hậu.

Một chàng trai có sức ảnh hưởng ở Trung Quốc đã thuê 1 con robot hình người để nấu ăn, dọn dẹp và đi hẹn hò cùng anh ta.

Liu Xue - một nhân viên văn phòng 25 tuổi - ví mối quan hệ của cô với Rafayel như một mối quan hệ lãng mạn ngoài đời thực

Sân bay Heathrow tại London, Anh phải đóng cửa sau 24 giờ kể từ vụ hỏa hoạn tại trạm biến áp điện ở phía tây London.

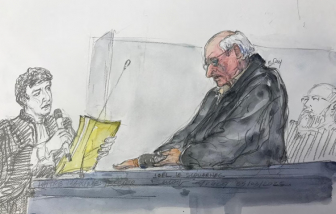

Cựu bác sĩ phẫu thuật người Pháp, Joel Le Scouarnec (74 tuổi) thừa nhận tội lạm dụng tình dục hàng trăm bệnh nhân, hầu hết dưới 15 tuổi.

Một người cha ở Trung Quốc đã treo giải thưởng 10 triệu nhân dân tệ (1,4 triệu USD) trong hành trình tìm kiếm đứa con trai bị bắt cóc 24 năm trước.

Ngày 20/3, Tổng thống Donald Trump đã ký sắc lệnh hành pháp yêu cầu Bộ trưởng Giáo dục Hoa Kỳ, Linda McMahon, bắt đầu giải thể Bộ Giáo dục.

Năm 2024 được xác nhận là năm nóng nhất kể từ khi vấn đề này được theo dõi cách đây 175 năm, phá vỡ kỷ lục trước đó vào năm 2023.

Một nghiên cứu trên hơn 37.000 người trưởng thành phát hiện ra rằng, việc nuôi dạy con cái có thể giúp trí não khỏe mạnh hơn khi về già.

Trong bảng xếp hạng Những quốc gia hạnh phúc 2025 thì Phần Lan là quốc gia hạnh phúc nhất. Và đây là năm thứ 8 quốc gia này được bình chọn.