PNO - Những kẻ lừa đảo ở Ấn Độ dùng AI giả giọng nói của trẻ em rồi sau đó gọi điện yêu cầu cha mẹ chúng chuyển tiền.

| Chia sẻ bài viết: |

Kỳ bí con tàu ma "lang thang" giữa biển lạnh

"Người đàn ông đội mũ” xuất hiện trong những giấc mơ liên quan gì tới "bóng đè"?

"Lời nguyền" về đoạn kết bi thảm cho người sở hữu viên kim cương đẹp nhất thế giới

Giải mã bức tranh ma ám “Người phụ nữ mưa”

Những “bóng ma”… đi nhờ taxi

Truy tìm những mùi hương đã mất

Ngày 26/3, Tổng thống Mỹ Donald Trump cho biết ông sẽ áp thuế 25% đối với tất cả ô tô nhập khẩu, từ ngày 2/4.

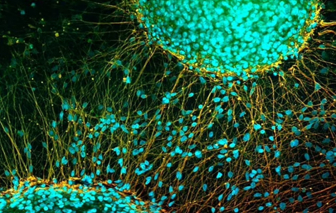

Một người bị liệt cột sống đã có thể đứng dậy và đi lại được, chỉ bằng một mũi tiêm chứa các tế bào gốc được “lập trình” lại.

Người già thường gắn liền với bệnh tật và cô đơn. Nhưng có những cụ trên dưới 90 tuổi vẫn đang tìm thấy niềm vui cho chính mình.

Báo cáo tiết lộ mức độ lạm dụng mà phụ nữ phải đối mặt trong chính trị từ các quốc gia như Úc, Ấn Độ, Lào và Mông Cổ.

1 phi công và 2 đứa trẻ sống sót sau 12 giờ kẹt trên cánh của chiếc máy bay bị chìm một phần trong hồ nước đóng băng ở bang Alaska, Mỹ.

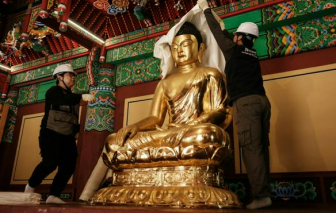

Ít nhất 16 người đã thiệt mạng khi nhiều vụ cháy rừng tiếp tục hoành hành dữ dội khắp khu vực đông nam Hàn Quốc.

Dữ liệu của chính phủ Nhật Bản công bố ngày 25/3 cho thấy, số vụ lạm dụng trẻ em ở mức cao kỷ lục là 225.509 trong năm tài chính 2023.

Cùng gia đình chạy trốn khỏi quê hương vì thiên tai, chiến tranh, những đứa trẻ chỉ mong được đến trường, vui chơi cùng bạn bè giữa một cuộc sống bình yên.

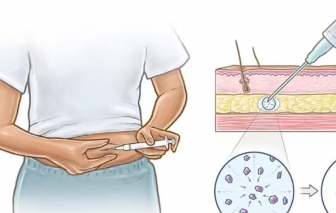

Các nhà khoa học đang phát minh ra loại thuốc tránh thai mới mà bạn tự tiêm như một giải pháp thay thế cho thuốc tránh thai.

Một ngôi chùa lịch sử đã bị thiêu rụi và một ngôi làng được UNESCO công nhận đã phải sơ tán khi Hàn Quốc nỗ lực khống chế các vụ cháy.

Thủ đô Seoul, Hàn Quốc đã dừng mở rộng tuyến tàu điện ngầm số 9 gần địa điểm hố tử thần trong quá trình điều tra vụ việc.

Không chỉ cấm phụ đi đi học,đi làm, tham gia cộng đồng, vui chơi, giải trí, Taliban còn cấm cả... cô dâu xuất hiện trong lễ cưới của chính mình.

Ngày 24/3, Liên hợp quốc cho biết sẽ có 2.000 ca nhiễm HIV mới mỗi ngày trên toàn thế giới và số ca tử vong liên quan sẽ tăng gấp 10 lần.

Một người đàn ông Nhật Bản bị kết án oan về tội giết người và là tử tù thụ án lâu nhất thế giới đã được bồi thường 1,4 triệu USD.

Công ty Samsung cho biết, vào sáng ngày 25/3, ông Han Jong-hee - Phó chủ tịch kiêm Tổng giám đốc điều hành của Samsung Electronics - đã qua đời vì đau tim.

Nghiên cứu của Anh và Mỹ cho thấy, tình bạn giữa những người thu nhập khác nhau giúp cân bằng khoảng cách giàu nghèo, thúc đẩy sự phát triển của xã hội.

Theo Tổ chức Y tế thế giới (WHO), tính đến tháng 2/2025, Ethiopia đã ghi nhận khoảng 59 ca tử vong do dịch sốt rét và dịch tả bùng phát.

Grooming là thuật ngữ dùng để mô tả quá trình kẻ xấu sử dụng để dần kiểm soát cuộc sống, thao túng tâm lý, quấy rối, xâm hại tình dục trẻ em.